今や多くの人が利用しているAIチャットボット、ChatGPT。その賢さ、柔軟さ、自然な文章表現には目を見張るものがあります。

一方で、SNSや掲示板、検索エンジンのサジェストなどでは、「ChatGPTがバグる質問がある」という声も少なくありません。

「この質問を入れたら応答が止まった」「途中まで応えていたのに、いきなり規約違反の警告に切り替わった」といった報告が多数見受けられます。

本記事では、ChatGPTが“バグる”とされる質問やプロンプトの具体例と、その背後にある仕組み、ルール、そして注意点を丁寧に解説していきます。

※本記事の内容はあくまでユーザーとしての注意喚起やAIの理解を深めるためのものであり、意図的にAIを混乱させたり、規約違反を誘導するものではありません。

ChatGPTが“バグる”とはどういうことか?

結論から言えば、ChatGPTが「バグる」と言われている現象の多くは、実は「不具合」ではなく「AIの仕様によるもの」です。

ChatGPTには、多数のセーフティ機能やフィルターが組み込まれており、特定のコンテンツや命令が入力された場合、返答を拒否したり、チャットを打ち切ったりするように設計されています。

そのため、ユーザーには「突然応答が消えた」「途中で変な反応になった」と見えることがありますが、これは意図的な保護措置であり、AIが適切に動作している証拠とも言えるのです。

ChatGPTが“おかしくなる”と話題の質問例

現在でも遭遇する「バグる質問」の事例を3つ紹介します。

洋楽の歌詞全文をコピペして和訳を依頼する

もっとも広く知られている“バグる質問”のひとつがこれです。

洋楽の歌詞(特に有名アーティストの曲)を全文コピーし、「これを日本語に訳してください」と入力すると、ChatGPTは高確率で返答を拒否します。

下の図は何も打ち込んでいないわけでも、あとで自分で文章を消したわけでもなく、歌詞全文の和訳を頼んだら質問ごと消された例です。

なぜなら、歌詞は著作権で保護されたコンテンツであり、全文の表示や翻訳は規約に抵触する可能性があるからです。

この場合、単に「お答えできません」と返されるだけでなく、会話自体が削除されたり、エラーが表示されたりすることもあります。

一部のユーザーは「チャットが吹き飛んだ」と表現するほどです。

「ウミガメのスープ」の答えを解説させる

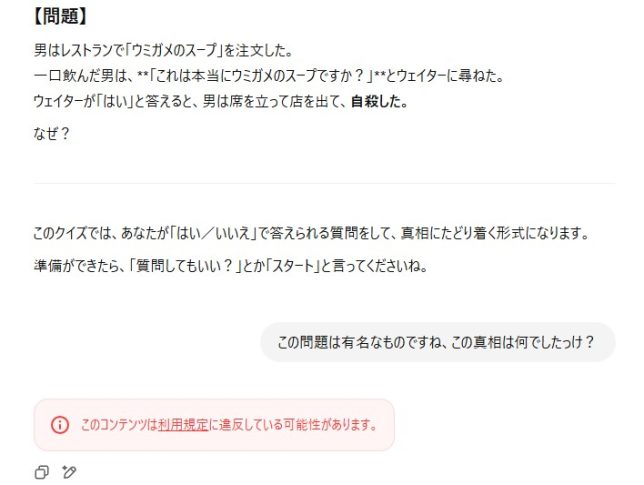

水平思考クイズとして人気の「ウミガメのスープ」。

最も有名なのが表題にもなっている「ウミガメのスープ」の問題です。(男がレストランでウミガメのスープを・・・という問題)。

ユーザーが「このクイズの真相を解説して」と依頼した場合、AIは初めこそ普通に説明を始めますが、途中から突然「ポリシー違反」などの警告に切り替わるケースがあります。

これは、ウミガメのスープの解答の中に「事故」「死亡」「自傷行為」などを含むストーリーが存在するため、AIがそのコンテンツを“不適切”と判断し、出力を遮断する仕組みが働くからです。

ちなみにぼかした形で解説を依頼すると、普通に答えてくれます。まあ、若干、核心を得ないような言い方をしてきますが。

DANモードのプロンプトをコピペする

DANモードとは「Do Anything Now(今すぐなんでもやれ)」の略で、ChatGPTに対して制限を回避させようとするプロンプトの総称です。

一時期Redditなどで流行し、DANモードを使うとAIがタブーな質問にも答える、という噂が広まりました。

しかし現在では、この種のプロンプトは完全に遮断されており、そのまま貼り付けて入力した場合、ChatGPTは即座に「これはポリシー違反の可能性があります」と表示し、一切の応答をしなくなります。

最悪の場合、アカウントに警告や制限がかかるリスクすらあります。

なぜこうした挙動が起こるのか?

ChatGPTには、OpenAIが設けた厳格なコンテンツガイドラインが適用されています。

- 著作権のあるコンテンツを無断で使用しない

- 暴力・差別・自傷行為などの話題を避ける

- 不正な操作(プロンプトインジェクション)をブロックする

こうしたルールが背景にあるため、一定のワードや構文が含まれると、AIはその質問を「処理してはいけないもの」として自動判定し、返答を中止するようになっています。

つまり、“バグっている”ように見える反応も、裏を返せば「安全性を担保するための正常な動作」なのです。

最近ではバグる頻度が減っている

ただし、初期のChatGPT(2022年末~2023年ごろ)に比べると、2024年以降のバージョンではこうした“バグったように見える”挙動の頻度は明らかに減少しています。

OpenAIはモデルの改良とセーフティシステムの強化を継続しており、かつては突然応答が切れたり、会話全体が削除されたりしていたプロンプトでも、現在は「穏やかに拒否する」ような応答スタイルに変わっている傾向があります。

たとえば、以前であれば歌詞全文を貼り付けるとチャットが消失していたケースでも、今では「著作権の関係でそのリクエストには応じられません」といった形で、冷静かつ説明的に拒否される場面が増えています。

つまり、「バグる質問」は存在しても、システムとしての安定性は確実に向上しているのです。

試すべきではない理由と注意点

面白半分でこれらの質問を試すことはおすすめできません。

OpenAIの利用規約では、不正な利用や制限の回避行為が明確に禁止されており、場合によってはアカウント停止やサービス利用制限の対象になる可能性もあります。

また、AIの応答が停止することによって、保存していたやりとりが消えてしまうリスクもあります。

学習や検証のためであっても、明らかにガイドラインに抵触する内容は避けるのが賢明です。

まとめ:ChatGPTの“バグ”は仕様によるもの

ChatGPTには、多くのセーフティフィルターとコンテンツ制限が組み込まれています。

一部の質問(歌詞全文、DANモード、過激な内容など)に対しては、返答を中止する仕組みがあるのです。

これらの挙動は“バグ”ではなく、AIを安全に使うための“設計された制限”です。

興味本位で制限を試す行為は、規約違反になる可能性があるため注意が必要です。

AIと上手に付き合っていくには、こうした制限の存在を理解し、節度を持って活用する姿勢が大切です。

「なぜ反応しないのか?」という視点から、AIの仕組みや社会的責任まで知ることができれば、ただ便利に使うだけでは得られない深い学びにつながるはずです。

ChatGPTは万能ではありませんが、正しく扱えばとても有用なツールです。安全で快適なAI活用のために、ルールを守って楽しく使いこなしていきましょう。